Introduzione: Il paradosso del GitOps moderno

Negli ultimi anni, l’approccio GitOps ha rivoluzionato il modo in cui i team IT gestiscono le infrastrutture e i rilasci software. Trasformando le configurazioni in codice, ha garantito ambienti riproducibili, deploy automatizzati e un rigoroso controllo delle versioni. Il successo di questo paradigma è innegabile: rilasciare software non è mai stato così sicuro e tracciabile.

Tuttavia, c’è un elefante nella stanza. Cosa succede dopo che il codice è arrivato in produzione?

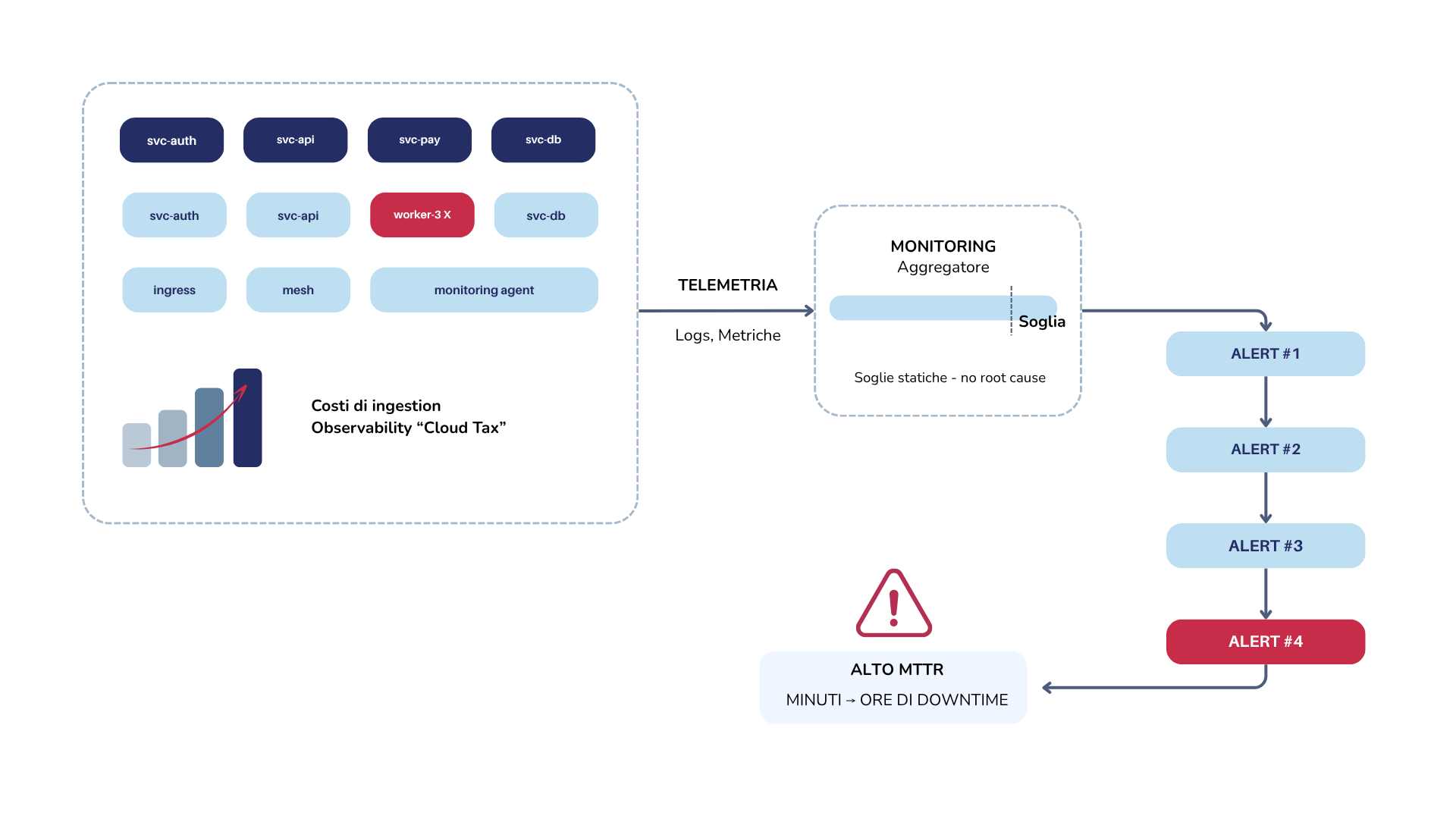

Nonostante l’automazione perfetta dei rilasci, il monitoraggio degli applicativi, l’analisi delle metriche e la gestione degli incidenti restano processi dolorosamente manuali. Quando un servizio va in errore, i team Operations si ritrovano spesso sommersi da dashboard caotiche, costretti a cercare il proverbiale “ago nel pagliaio” spulciando log interminabili.

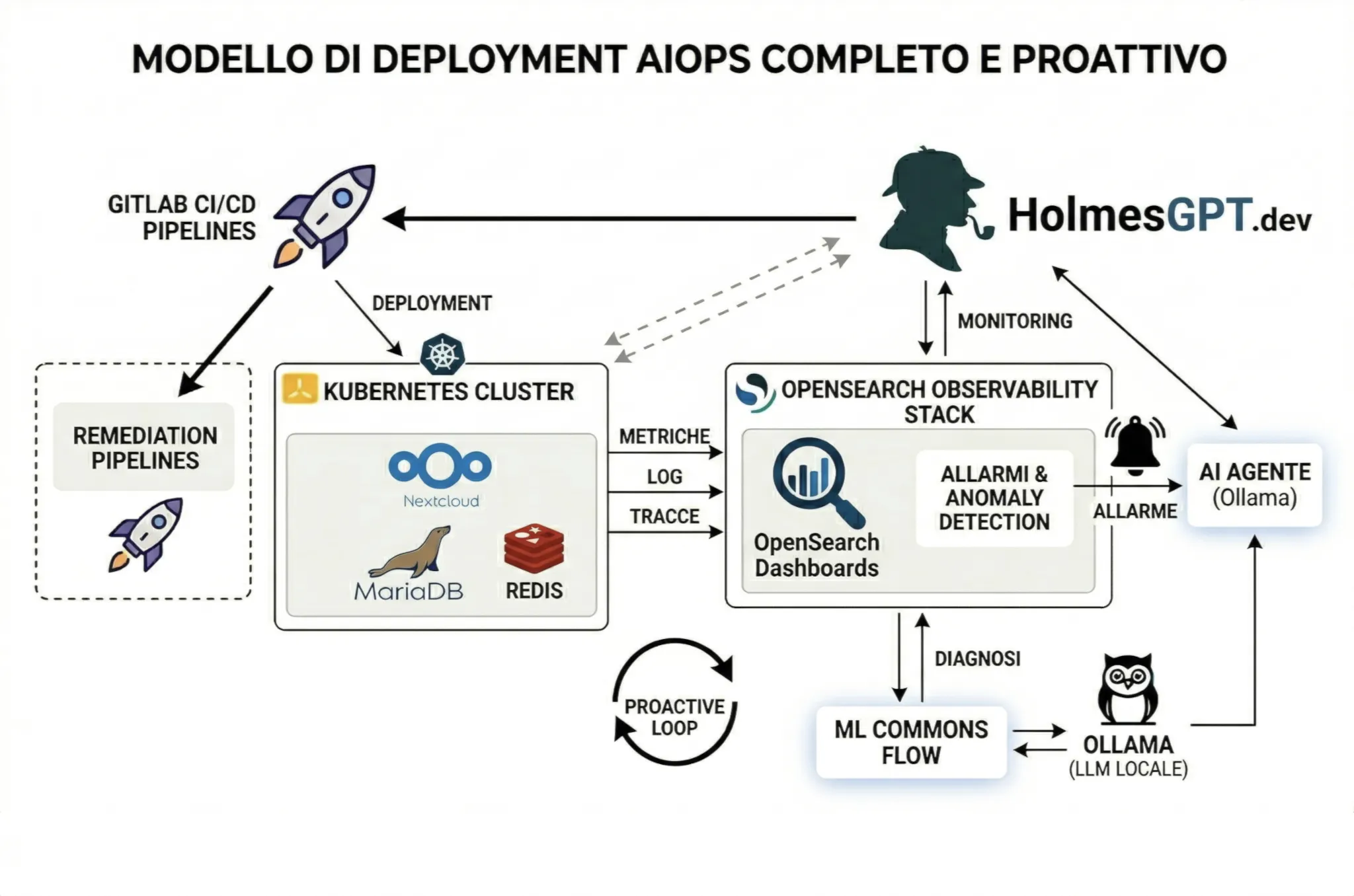

Oggi, il mercato offre diverse soluzioni AIOps (Artificial Intelligence for IT Operations) “chiavi in mano” per risolvere questo problema. Tuttavia, si tratta spesso di scatole nere proprietarie con costi proibitivi e che richiedono l’invio di dati aziendali sensibili verso cloud di terze parti.

La vera sfida è compiere il salto da GitOps ad AIOps mantenendo il controllo assoluto della propria infrastruttura.